Une nouvelle campagne de phishing utilise ChatGPT pour escroquer les investisseurs

Essai gratuit de 30 jours

ChatGPT, l'agent conversationnel (chatbot) basé sur l'intelligence artificielle développé par le labo OpenAI, est devenu célèbre en seulement quatre mois.

Malheureusement, le succès de l'outil viral d'IA a également attiré l'attention des fraudeurs qui utilisent la technologie pour mener des escroqueries d'investissement très sophistiquées contre les internautes imprudents.

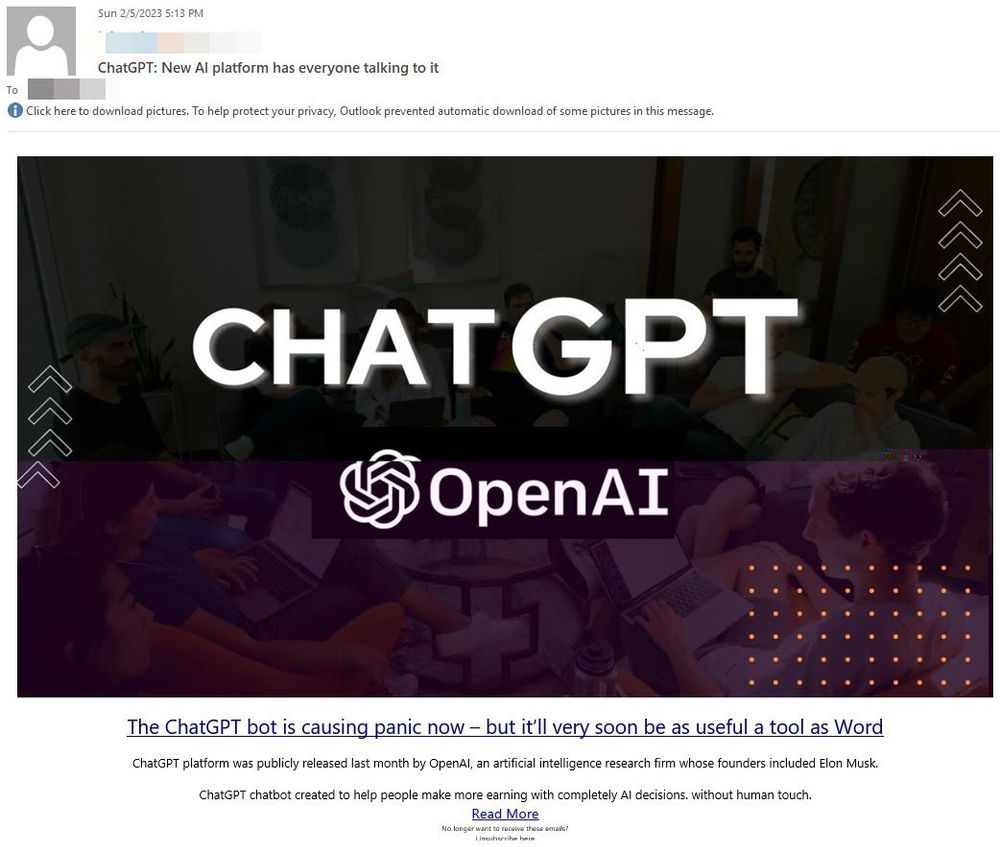

Selon Bitdefender Antispam Labs, le tout nouveau chapitre des escroqueries "alimentées par l'IA" commence par un simple e-mail non sollicité.

Les lignes d'objet incluent :

- ChatGPT : le nouveau bot AI rend tout le monde fou

- ChatGPT : le nouveau bot AI choque tout le monde

- Le nouveau chatbot ChatGPT rend désormais tout le monde fou - mais ça deviendra très bientôt un outil aussi banal que Google

- Pourquoi tout le monde panique-t-il à propos du bot ChatGPT ?

En fait, ce qui semble être un leurre marketing bénin a rapidement attiré l'attention de nos chercheurs, qui ont ensuite révélé un stratagème de fraude complexe qui menace les portefeuilles et l'identité des participants.

Pour l'instant, le programme cible le Danemark, l'Allemagne, l'Australie, l'Irlande et les Pays-Bas.

L'e-mail semble offrir peu d'informations aux destinataires, à moins qu'ils n'accèdent au lien intégré, bien sûr.

Comment l'arnaque fonctionne

Bien que de fausses applications ChatGPT aient fait leur apparition sur les stores officiels de Google et Apple au cours des deux dernières semaines, offrant aux utilisateurs des abonnements mensuels ou hebdomadaires pour utiliser l'outil, les escrocs derrière ce schéma particulier vont au-delà pour duper les consommateurs.

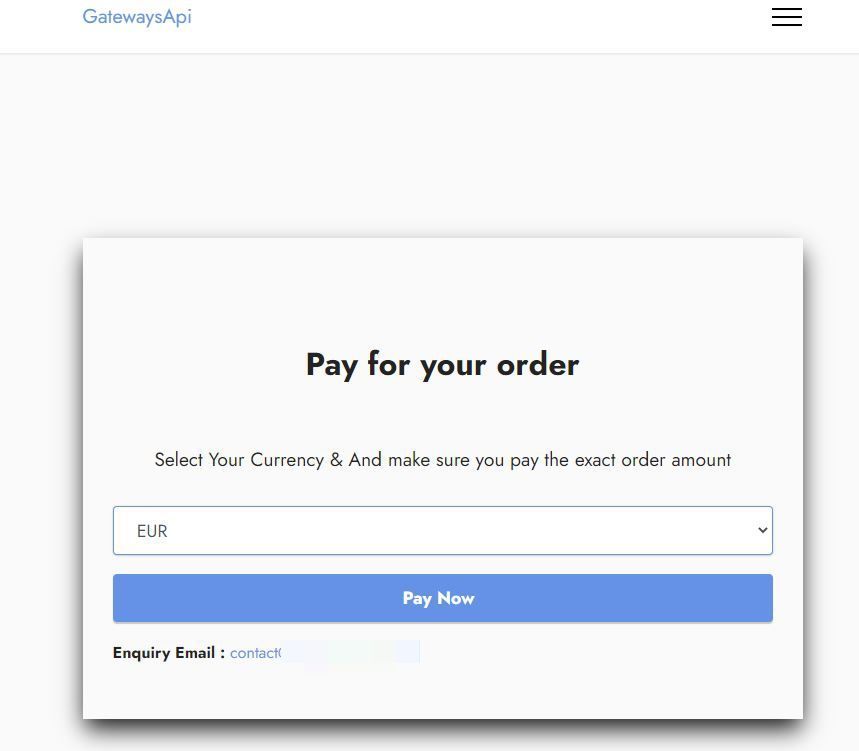

En accédant au lien dans l'e-mail, les utilisateurs sont dirigés vers une imitation de ChatGPT attirant les utilisateurs avec des opportunités financières qui rapporteraient jusqu'à 10 000 $ par mois "sur la plate-forme unique ChatGPT".

Comme vous le savez très probablement, le ChatGPT officiel est un outil de traitement du langage basé sur l'IA qui permet des conversations écrites de type humain avec un chatbot qui peut répondre aux questions, aider à composer des e-mails, des dissertations et bien plus encore. Ce n'est pas une plate-forme d'investissement boursier ou financier destinée à vous faire gagner de l'argent.

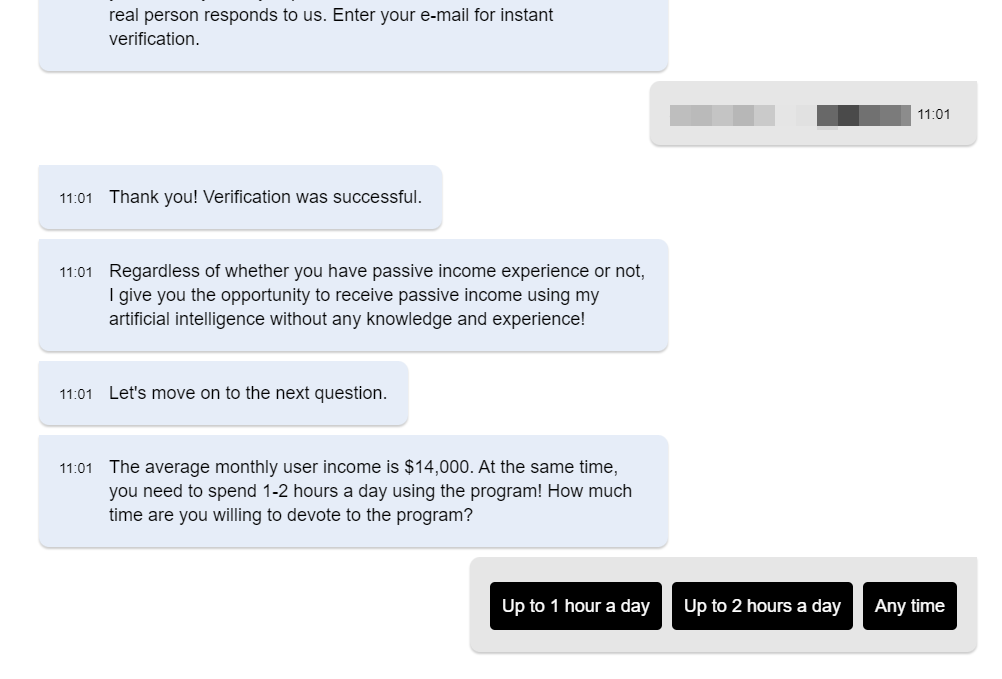

Le "chatbot" de la plate-forme bidon commence par une courte introduction à son rôle dans l'analyse des marchés financiers qui peut permettre à quiconque de devenir un investisseur prospère dans les actions mondiales. Nous avons accepté de jouer le jeu et de permettre au "robot automatique créé par Elon Musk" de nous aider à devenir riches. Avant de commencer notre parcours d'investisseur, le chatbot doit calculer notre revenu quotidien.

Après avoir été interrogé sur le niveau de satisfaction de notre niveau de revenu actuel, le faux bot ChatGPT nous demande de vérifier si nous sommes « réels » en saisissant une adresse e-mail. Nous avons accepté, et « l'IA » était plus que disposée à nous aider.

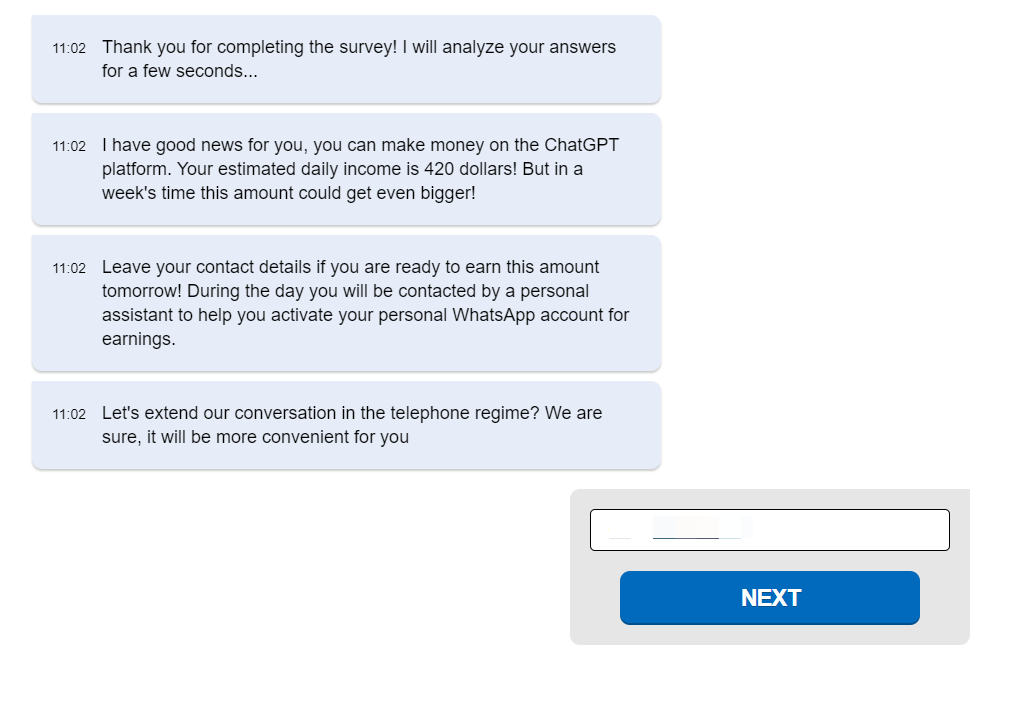

Rien de trop louche jusqu'à ce que nous nous dirigions vers la partie suivante. Sans donner à la plate-forme bidon aucune information financière personnelle qui pourrait l'aider à générer une estimation potentielle d'un "revenu mensuel d'utilisateur", le bot estime miraculeusement un revenu quotidien de 420 $ et indique un montant qui "pourrait encore augmenter" en une semaine. Maintenant, on nous demande de fournir des informations de contact supplémentaires pour notre propre "assistant personnel" afin de nous aider à activer un compte WhatsApp dédié à nos revenus.

Nous n'avons pas pu résister et avons fourni au chatbot un numéro de téléphone valide, et avons attendu patiemment d'être contactés par un représentant.

En 10 minutes, nous avons reçu l'appel d'une charmante jeune femme qui parlait roumain. Elle a eu la gentillesse de nous donner plus d'informations sur la façon dont nous pouvons commencer à gagner de l'argent très rapidement en investissant dans "la crypto, le pétrole et les actions internationales".

Cette personne était très polie et curieuse de savoir combien gagnait notre chercheur. Elle a demandé combien d'argent il était capable d'investir aujourd'hui, précisant que le minimum est de 250 euros.

Alors qu'elle insistait pour passer à WhatsApp pour commencer une analyse financière et créer un compte, elle a déclaré que nous devions fournir les six derniers chiffres d'une carte d'identité valide. Nous avons sauté cette étape en lui demandant de nous envoyer un e-mail contenant le lien dont nous avions besoin pour accéder au transfert des 250 euros et commencer notre nouvelle carrière dans la finance en tant qu'investisseur débutant.

En passant, notre chercheur pouvait entendre en arrière-fond de nombreuses voix parler au téléphone à d'autres victimes, dans ce qui ressemblait à un environnement de type centre d'appels.

Après quelques minutes de conversation avec l'employée, elle a demandé à l'un de ses collègues de nous envoyer le formulaire que nous devions remplir pour commencer à investir.

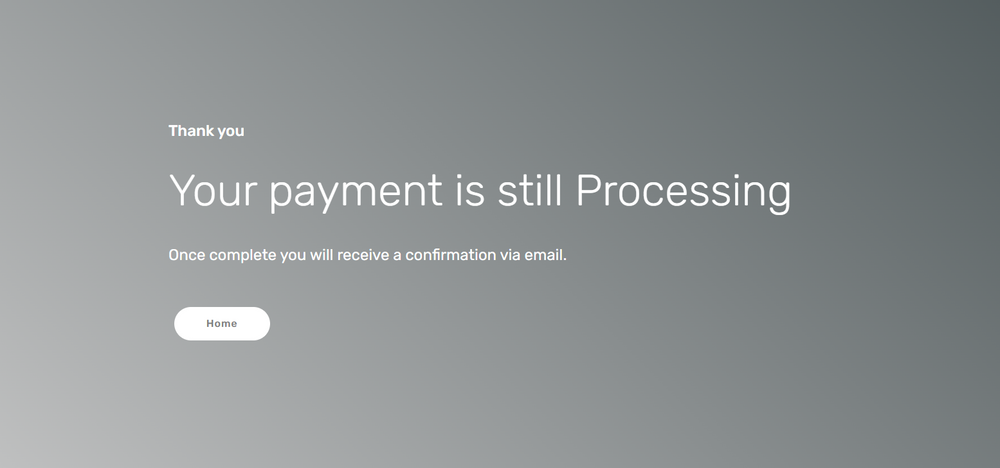

On nous a conseillé d'entrer le montant de 250 EUR et d'envoyer une capture d'écran montrant que le paiement est toujours en cours de traitement.

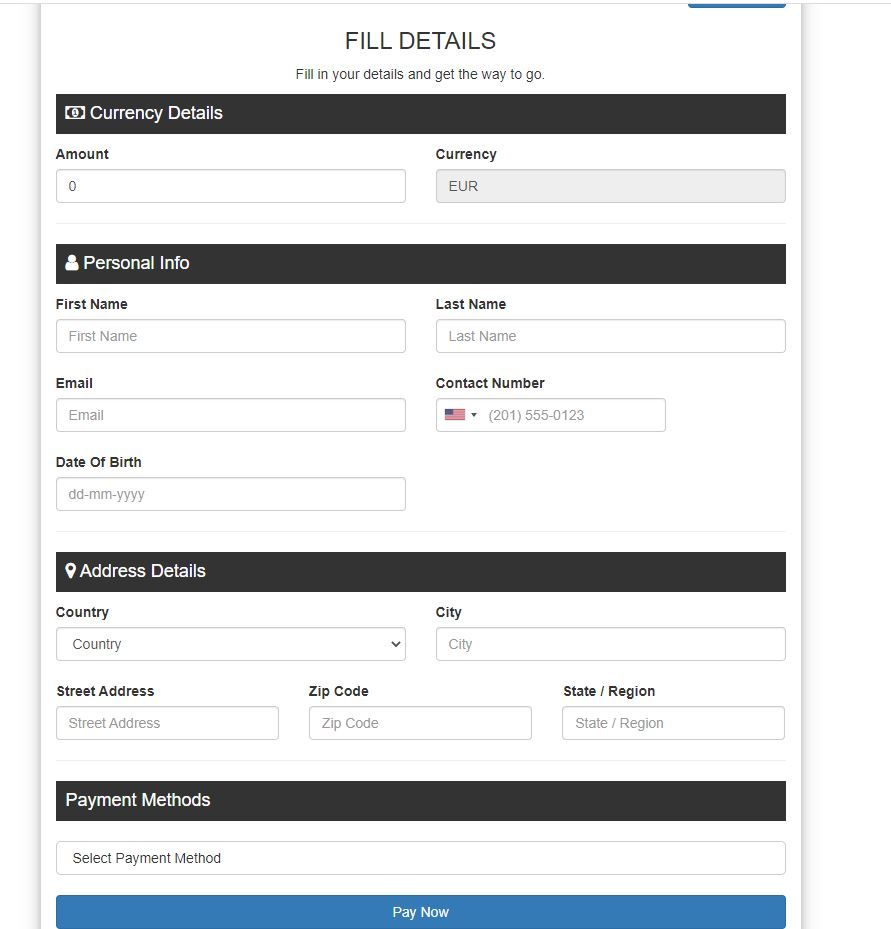

Comme vous pouvez le constater, le formulaire nécessite une variété d'informations personnelles, notamment le nom et le prénom, la date de naissance, l'adresse physique et le mode de paiement.

Nous avons utilisé un numéro de carte de crédit inventé pour voir ce qui se passerait ensuite.

Le « paiement » n'a pas abouti, et la femme a conseillé à notre chercheur de répéter le processus, en s'assurant qu'il n'y avait pas de fautes de frappe. Elle nous a également recommandé d'être très prudent lors de la saisie pour éviter que la banque ne bloque la carte de crédit.

Quelques notes intéressantes que nos chercheurs ont soulignées :

- L'employée qui a parlé avec notre chercheur a dit qu'elle travaillait pour Import Capital, une entreprise basée à Londres. Notre enquête a révélé que le domaine importcapital[.]cc (comme indiqué dans notre correspondance par e-mail avec la société) figurait également dans une alerte de la Financial Conduct Authority (FCA) indiquant que la société n'était pas autorisée à exercer ses activités au Royaume-Uni.

- Les chercheurs de Bitdefender Antispam Lab ont également repéré quelques variantes de la campagne de phishing utilisant le nom de Google et Meta. Comme pour l'escroquerie ChatGPT, ces messages demandaient aux clients de remplir un formulaire avec leurs coordonnées.

- Le site de paiement est dépourvu de tout texte descriptif mentionnant Import Capital, ChatGPT ou toute entité réceptrice quelle qu'elle soit. De plus, le formulaire de paiement est librement accessible sans aucune vérification préalable ni mesure de sécurité, directement depuis la page principale du domaine.

- La fausse version de ChatGPT était accessible via un domaine déjà mis sur liste noire https://timegaea[.]com. Cette version copycat ne permettait pas à notre chercheur d'interagir librement avec le "chatbot". Vous ne pouviez sélectionner que des réponses prédéfinies.

- L'employée a posé des questions sur les membres de notre famille qui pourraient avoir un revenu plus élevé et a semblé très intrigué lorsque notre chercheur a dit oui.

- L'employée a également interrogé notre chercheur sur ses comptes d'épargne.

- Les utilisateurs pouvaient sélectionner plusieurs devises avant de remplir le formulaire de paiement. Cela inclut USD, EUR, GBP, AUD et CAD.

- Les méthodes de paiement incluent les cartes de débit, les cartes de crédit et Klarna

- L'appel téléphonique reçu par nos chercheurs provenait du Royaume-Uni et l'employée a déclaré qu'elle travaillait à Londres.

- L'opération d'escroquerie semble cibler les utilisateurs du monde entier

- Le processus de vérification de WhatsApp exige que les utilisateurs donnent les six derniers chiffres de leur identifiant. Associé aux informations du formulaire de paiement (par exemple, la date de naissance), cela pourrait permettre aux escrocs de créer un numéro d'identification complet et de commettre une usurpation d'identité.

Comment les utilisateurs peuvent se protéger contre les escroqueries ChatGPT

Les escrocs utilisant de nouveaux outils ou tendances Internet viraux pour escroquer les utilisateurs n'ont rien de nouveau. Si vous cherchez à tester le ChatGPT officiel et ses capacités de génération de texte alimentées par l'IA, faites-le uniquement en utilisant le site officiel.

Ne suivez pas les liens que vous recevez via une correspondance non sollicitée et méfiez-vous particulièrement des stratagèmes d'investissement au nom de l'entreprise, ils constituent une arnaque.

Si vous avez besoin de plus de tranquillité d'esprit lorsque vous parcourez le Web et interagissez avec des applications, ou une correspondance non sollicitée, jetez un coup d'œil aux solutions tout-en-un de Bitdefender.

Nos suites de sécurité complètes vous protègent contre les attaques, les logiciels malveillants, les sites Web d'hameçonnage et d'escroquerie, et notre service de protection de l'identité numérique surveille en permanence toute fuite de données privées pour vous aider à prévenir les tentatives d'usurpation.

tags

Auteur

Actualités Les + populaires

Qu'est-ce que l'empreinte numérique et pourquoi les pirates veulent-ils la vôtre?

Avril 13, 2023

Microblogging, désinformation et risques pour la vie privée

Mars 21, 2023

FOLLOW US ON SOCIAL MEDIA

Vous pourriez également aimer

Marque-pages